引言

游戏开发者大会(英语:Game Developers Conference,缩写:GDC)是规模最大的游戏开发者年度专业性质会议与展览,每年在旧金山召开一次,已举办35届。今年的GDC于2022年3月21日-25日在旧金山圆满落幕。

GDC重头环节是非赞助类主题演讲,每届主办方平均邀请不足300场,分核心(Core)与峰会(Summit)两大类别。演讲嘉宾经过主办方及其全球顾问委员会精心挑选并邀请,以高质量和创新性而备受行业认可,演讲内容代表着游戏行业当前的最高水准与发展趋势。

经过激烈的筛选,网易互娱AI Lab共有四项研究成果入选,向来自世界各地的开发者们分享了在人工智能领域,游戏研发运营、资源生产等新技术。这四项成果分别入选了GDC 2022 Core、GDC 2022 ML Summit 和 GDC 2022 Tool Summit,彰显了网易互娱AI Lab在人工智能多个领域已经具备国际顶尖的技术创新能力,也印证了其近年来在游戏领域的技术探索和突破已经获得了业界权威的认可。

提案介绍

以下是网易互娱AI Lab入选的4篇提案:

1. Reinforcement Learning for Efficient Cars and Tracks Design in Racing Games(《在赛车游戏中利用强化学提高赛车和赛道设计效率》)

该方案入选 GDC 2022 Core

赛车游戏中,不同赛车的驾驶差异性和赛道的漂移感是影响游戏体验的关键因素。以往在此类游戏开发阶段,以上两点需要耗费巨量的人工测试:

1.赛车的差异性需要极限水平下才能测试,高水平玩家才能更好地辨别出赛车和赛道的极致差异;

2.赛车和赛道种类的提高,极大增加了测试工作量,这给游戏的设计带来了巨大挑战。

此成果利用异步强化学采样算法,构建出能快速批量测出不同赛车的驾驶差异和验证弯道漂移感的系统。利用非常少量的计算资源,可以实现:

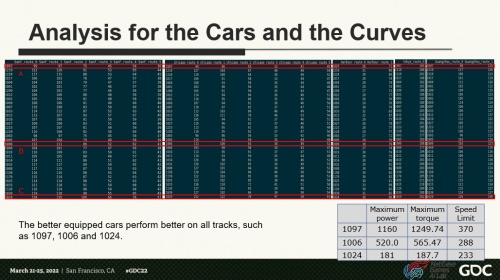

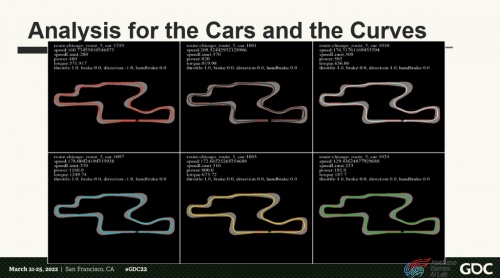

1.1小时内能跑出50种不同车辆在同一赛道中超越顶级玩家的顶级水平,以验证赛车的差异性。图一显示了不同赛车在不同赛道的极致时间,图二显示了不同赛车在统一赛道的行驶轨迹,可以看到不同的车辆的驾驶差异,例如入弯特性差异等;

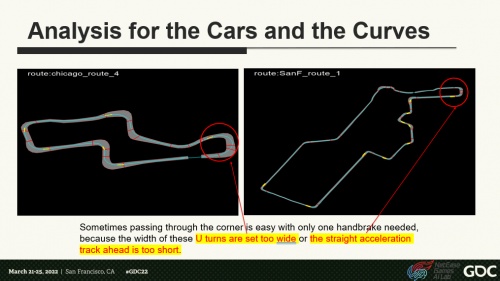

2.在拟人类操作约束下,给出不同弯道是否需要手刹飘逸和飘逸区间,以验证赛道设计的漂移感是否符合预期,极大降低了游戏开发成本。图三中红色线之间代表策划人为划出的先验手刹区间,黄色点表示AI在该弯道的连续手刹操作。

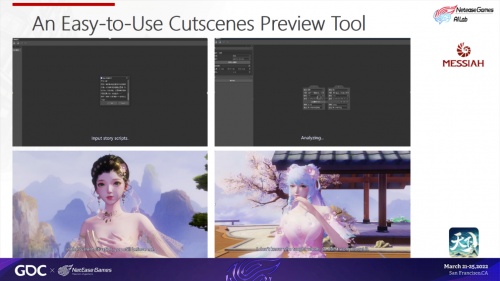

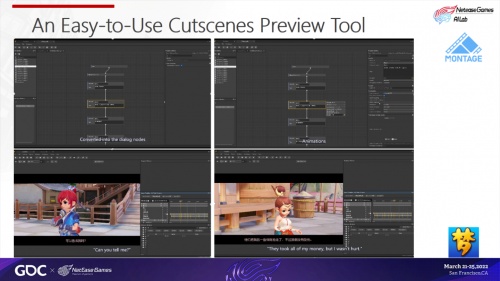

2. An Easy-to-Use Cutscenes Preview Tool with Low Resources(《一个易用且低资源依赖的过场动画预览工具》)

该方案入选 GDC 2022 Tool summit

标准的剧情动画设计通常先由游戏设计师构建故事情节,然后资源制作组基于故事情节来制作动画。但是这个动画设计过程往往伴随着多次沟通和修改,因为制作的动画不一定能与游戏设计师的想法所对应,这个过程会浪费大量的时间和人力。

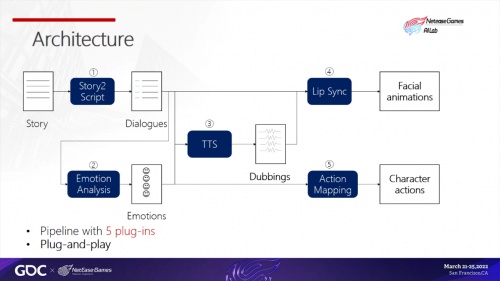

为了提高角色动画制作过程中的沟通和开发效率,我们制作了一个低资源依赖的易用过场动画预览工具。这个工具包含5个插件,可以根据游戏剧本一键生成配音和动画原型。游戏设计师们可以轻松地利用这些插件来构造原型,方便后续沟通和修改。不仅有效减少了资源的浪费,还简化了剧情动画开发过程中的沟通和调整。

剧情动画生成方案包含5个插件:小说续写、小说转剧本、剧本情绪分析、情感可控语音合成、嘴型表情动画合成。每一个插件既可以相辅相成,又可以单独拎出来成为一个小部件,即插即用。

方案的整体流程是:

1.先输入一段小说,或者一个片段的开头,小说续写模块可以天马行空地续写到无穷长。

2.然后基于输入或者生成的小说形式的文本,通过小说转剧本模块,转换成“角色:对白”这样的节点图。

3.得到节点图后,通过剧本情绪识别模块,对每句对白提取出对应的情绪。

4.将角色、对白以及情绪输入到语音合成模块中,输出带有情绪的配音合成文件。

5.嘴型表情动画模型将配音和对白进行自动对齐,然后合成出对应的嘴型动画,同时也使用情绪结果来产生对应的表情动画。

目前方案中的4个插件已全部接入Montage和Messiah的剧情编辑器中。每个插件也可以单独拆分,服务于相应的功能。

3. Aegis Engine: Building Multi-modal Moderation System in NetEase Games(《Aegis引擎:多模态审核系统构建及其在网易游戏中的应用》)

该方案入选 GDC 2022 ML Summit

用户生成内容(UGC)和社交互动极大地提高了玩家的参与度和游戏的娱乐性。为了使游戏远离违规内容,比如色情、暴力、有害信息等,构建一个内容审核系统至关重要。然而,人工审核需要耗费大量时间、人力和资金。本报告将介绍网易互娱AI Lab自研的Aegis引擎,一个运用深度学技术搭建的多模态内容审核系统,可以审核文本、图像以及音频等多模态的数据。

Aegis引擎包含了三个子系统,图像子系统挖掘细粒度识别和实时OCR算法,音频子系统基于关键词增强和噪声鲁棒的语音识别技术搭建,文本子系统包含基于文本嵌入的违规内容挖掘方法等。

Aegis系统每天可以处理千万级别的图片和数十万个小时的语音数据,几乎覆盖了网易互娱的所有游戏。

4. AI Animator : A Real Time Motion Completion System(《AI动画师:实时动作补全系统》)

该方案入选 GDC 2022 ML summit

快速、轻量、高质量的动画合成是游戏业界一直所追求的。现行方案主要是利用线性插值完成简单动作插帧,本次演讲中,我们提出了一个统一的实时动作补全深度学框架。该框架可以覆盖常见的动画制作场景,如手动K帧,动画Blending衔接,动作动画的“超分辨”等。

实验表明,该算法目前在育碧公开的大规模高质量数据集LaFAN1(包括步行、跑步、跳舞等复杂动作)上,达到了最佳的速度和效果(比之前的的sota高17%)。除此之外,我们的方法可以实现CPU实时(30帧0.025s),抵抗30db的动作数据噪声污染,具体来说:

1.AI辅助手动K帧(In-betweening):算法在过去的帧和提供的新关键帧之间逐帧生成,为美术减少工作量,同时可以为没有美术人员的项目实现任意模型的动作动画制作。

2.填充(In-filling)。作为中间的延伸,填充将角色置于时间线的特定位置并补充其余的帧。填充的一个子任务是动作的超分辨,其中输入帧被视为具有相等间隔的关键帧,算法可以补全中间动画。

3.衔接混合(Blending):Blending侧重于自动生成一对预定义动作片段之间的过渡。例如,我们的算法可以实时生成较高复杂度的舞蹈片段中间过渡,以帮助使用者集中注意力在动画内容本身。

蓝色部分为输入关键帧,中间其他色为算法生成结果。

为了增强动画多样性,动画展示的是同一输入条件下,我们控制生成的多种不同结果。

网易互娱AI Lab

网易互娱AI Lab成立于2017年,隶属于网易互动娱乐事业群,在广州、杭州、上海均有分部,是游戏行业领先的人工智能实验室。实验室致力于计算机视觉、语音和自然语言处理,以及强化学等技术在游戏场景下的的研究,应用和落地,旨在通过AI技术助力互娱旗下热门游戏及产品的技术升级,目前技术已应用于网易互娱旗下多款热门游戏,如《梦幻西游》《哈利波特:魔法觉醒》《阴阳师》《天下3》等等。