当摄影师蔡斯·贾维斯(Chase Jarvis)提出了著名的谚语:“最好的相机就是您所拥有的相机”时,他揭示了一个不言而喻的事实:即使拥有数码单反相机和专用摄像机,即使是专业人士也携带傻瓜相机。他的信息是,伟大的摄影师创造用他们手头上有优秀的画面,但人气清盘设置阶段为传统影像的巨大破坏-一个亲眼看见著名的人像摄影师安妮·莱博维茨的怀抱谷歌的像素照相机和电影制片人史蒂芬索德伯格开始用iPhone拍摄电影。

由于许多负面原因,人们会记住2020年,但也应将其标记为技术赶上并重新定义Jarvis话语的时间。很大程度上要归功于高通和苹果公司改进了传感器和移动处理器中的神经核,这一年是单机照相和摄像机数量超越的一年。通过智能手机以重要的方式使用,例如,“随身携带的相机”实际上将成为您最好或最有能力的相机。与单用途相机不同,最新的智能手机现在可以创建对象和房间的3D扫描,经过AI优化的图像以及影院级Dolby Vision HDR视频,即使是专业相机也无法复制。iPhone和Android手机似乎曾经看起来不太可能,但现在正在改变企业和消费者对图像的看法。

我们现在正处于内容记录新时代的开始,随着专业2D制作工具的民主化,传统的摄影和摄像将发展,新工具将使创建3D内容毫不费力地用于增强现实和混合现实。机器学习是这一变化的核心:在眨眼间,经过训练的AI在神经芯上运行,现在可以将10张照片的最佳部分缝制为一张理想的图像,或保证视频的灯光,阴影和颜色能够看起来比以往更真实。人们是否会改变使用相机的方式并消费其他人捕获的东西还是每个人是否会回到旧规范尚待观察,但是在历史上特别黑暗的一年之后,成像的未来看起来比以往任何时候都更加光明。

为了提供有关变化的动手实践知识,我花了三周时间在Apple的iPhone 12 Pro上,花了一个周末在iPhone 12 Pro Max上,这些设备能够实现大多数但不是全部上述创新,这要归功于它们的16核心神经处理器和更新的相机传感器。这是我对今天的立场和前进方向的总体看法。

3D捕捉,激光雷达和数字双胞胎

去年,部分三星Galaxy手机开始包含3D深度扫描相机,这是一项令人兴奋的硬件功能,但软件支持有限。一个三星的应用程序称为3D扫描仪可以围绕一个真正的对象的人的举动(如布娃娃)将其扫描到3D模型,然后平移运动的人的3D深度数据的动画模型的四肢。这个概念并不是超级实用,特别是因为它要求将人员的动作记录在设备的背面,这意味着电话的用户将不得不寻找其他人来“执行”。三星从今年的Note20手机拉到了硬件,看到了索尼开发的报道后,激光雷达三维扫描仪在苹果公司最新的iPad的优点发现是在一个完全不同的水平。

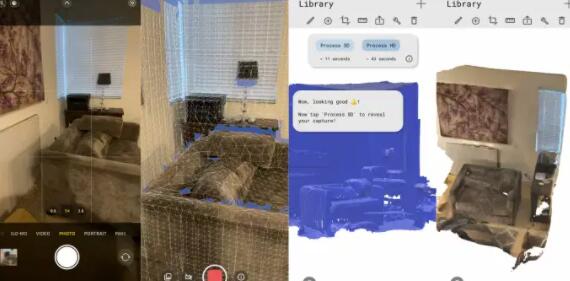

现在,苹果公司在iPhone 12 Pro和Pro Max中增加了激光雷达扫描功能,尽管苹果公司本身所做的工作不足以展示该技术,但克里斯托弗·海因里希(Christopher Heinrich)的应用程序Polycam令人印象深刻地展示了3D扫描使之成为可能。使用Lidar和AI,一种可插入口袋的设备现在可以轻松地对物体和整个环境(例如,一个房间或一个房间中的多个房间)创建3D扫描,然后可以在三个维度上查看和移动它们。如本文顶部的图像所示,您只需按一个记录按钮,然后在屏幕从蓝色变为白色以指示成功捕获时在对象或空间周围走动。使用Lidar进行深度测量,并使用Apple的处理器进行快速重新计算,Polycam的三角形网格可以实时进行细化,以更正确地反射附近和远处物体的轮廓,同时在您移动时相机填补纹理间隙。停止记录一分钟后,您将拥有可以保存和共享的完整且极其精确的3D模型。

这种惊人的计算和成像技术组合的最终结果就是今天所称的“数字孪生兄弟” —可以从任何角度进行探索的真实空间和物体的3D模型,并有望在接下来的5-10年中传播到各处年份。这些真实的3D捕获与Lytro的作品形成了鲜明的对比,Lytro在过去的十年中试图说服人们摄影的未来在于可重新聚焦的静态图像,但从未受到企业或消费者的青睐。取而代之的是,电话现在正在对整个房间创建逼真的扫描,可以从任何角度进行探索。

想象一下真正3D摄影的可能性:您可以创建自己的家庭或办公室的3D版本,并用它远程控制远处的灯,电器,电视或计算机,将其用作社交场合的虚拟聚会场所,或您最喜欢的现实世界空间成为游戏的背景。用于增强现实和人类头像创建的其他3D扫描应用程序已经在世界范围内进行测试。我们才刚刚开始看到这种新的3D摄影技术将带给我们什么,事实是它有望在很短的时间内进入数千万个设备,这意味着它不仅会被开发人员所忽略。

大传感器和下一代计算摄影

高通去年发布Snapdragon 865时,最引人注目的卖点之一就是支持大型相机传感器-100和200兆像素,而iPhone相机上通常只有12百万像素。高通公司及其合作伙伴预测,超变焦水平细节将有所增加,这样一来,电话摄像头将以1倍变焦捕获相同数量的细节,而大型独立摄像头可能会聚集10倍或20倍变焦镜头。小米和三星随后发售了108万像素的摄像手机,但200万像素的传感器尚未进入设备。

这些高分辨率传感器使智能手机相机可以在像素数量上与最昂贵的单反相机竞争。但是提高像素质量也很重要,这就是苹果今年的发展方向。

iPhone 12 Pro Max具有iPhone上物理上最大的摄像头系统,这不是因为捕获了更多的像素,而是因为更大的像素使相同尺寸的图像比以前更真实。苹果没有将相机的分辨率从12兆像素提高到1.7微米,而不是将三星的108像素传感器的0.8微米增加到1.7微米。换句话说,四个三星像素可以容纳一个苹果所占据的相同正方形空间。这一差异使三星可以增加细节,而苹果则致力于提高光敏度和色彩准确性。

在苹果公司的旗舰iPhone 12 Pro Max中,这使2D图像看起来比以前更清晰-在普通照明条件下与DSLR质量几乎没有区别,并且在弱光下其噪声和颗粒感明显低于竞争对手的解决方案(或较旧的iPhone)。在测试过程中,可用的,干净的照片与模糊照片的比例越来越高,这给我留下了深刻的印象,这是结合使用更大的镜头,更好的聚光效果以及自动AI辅助选择瞬间获得的最佳图像的最终结果。曝光过程。

但是,即使是没有大型摄像头系统的较小型的iPhone 12 Pro也可以从许多改进中受益,尤其是在软件方面。Apple推出了Smart HDR 3,该产品使用机器学习和图像分割功能来确定同一幅图像的多次即时拍摄但不同曝光的图像各个部分(例如天空和风景)的适当曝光。它还使用Deep Fusion将这些曝光中最清晰的细节合成到最终照片中。

在传统相机上,这几乎是不可能的,而且一些专业摄影师可能会争辩说,违反物理的计算摄影“疯狂的科学”正在作弊,特别是因为它比那些接受照片训练的人更快,更聪明。谷歌,高通和苹果似乎并不关心,因为捕获的产品的质量每年都在不断提高,而传统相机在很大程度上仍保持在五年前的水平。Apple甚至现在通过一种名为ProRAW的新图像格式迎合专业人士,从而可以对iPhone 12 Pro和Pro Max相机拍摄的增强RAW图像进行细微调整,包括关闭或调整基于AI的调整的功能。

最终结果很明显:无论您选择的是Android手机还是iPhone,对于大型独立摄像头的需求都在逐渐消失。传统的2D摄影概念已逐渐过时,在这个2D摄影中,摄影师试图最大程度地利用相机的快门在一次单击时曝光的一切。

4K视频,现在支持Dolby Vision HDR

高通去年展示了Snapdragon 865时,声称该处理器是第一款实时捕捉杜比视界4K HDR素材的视频,这种视频具有专业电影品质的色彩,亮度和阴影细节。但是,正如高通作为芯片供应商的重担一样,要真正成为“第一个”,就需要合作伙伴公司使用Snapdragon 865,合适的相机和合适的软件来生产智能手机。那还没有发生。

事实证明,苹果公司实际上是第一个使用完全不同的芯片:A14 Bionic来实现杜比视觉记录摄像电话的商业化产品。苹果在10月宣布,iPhone 12 Pro和Pro Max是“有史以来第一款在杜比视界中录制的摄像机”,不仅能够进行10位HDR录制,而且还可以进行实时编辑和简单流式传输到Apple TV 4K设备和支持AirPlay 2的智能电视。创建Dolby Vision以前是后期制作过程,需要独立的计算机,但是A14 Bionic的速度使其能够在录制视频时以每秒60帧的速度发生。

苹果的实现远非完美。使用Dolby Vision创建的视频在iPhone屏幕上色彩准确,但是在上载到第三方视频服务或在某些电视机上显示时看起来并不正确,因为所需的Dolby Vision软件版本比随附的版本更新。大多数高清电视。例如,尝试在Instagram上共享视频将导致颜色看起来褪色或斑点,而不是所期望的饱和或丰富细节。在此问题得到解决之前,一些(也许甚至是大多数)iPhone 12用户可能更喜欢在没有Dolby Vision HDR的情况下进行录制。

当然,普通人可能不需要甚至不在乎制作看起来像好莱坞大片一样出色的家庭电影。在某些情况下,差异不会明显。但是在单帧内明暗之间存在极大差异的情况下-明亮的高光,暗阴影-或成千上万的颜色,否则可能会造成斑点,带有不准确,不真实的细节,HDR摄像机将提供卓越的细微差别并提高地板,用于智能手机拍摄。他们已经在以高分辨率和帧频进行拍摄,这对于将来的拍照手机以及对多台电视的支持都是一个好兆头。

AI作为安静的使能器,并由此发展了相机配件

很难夸大AI对摄影的影响。上面的许多创新都是通过智能手机芯片中的神经内核,机器学习来实现的,这些机器学习使相机能够主动识别(或“分割”)照片,视频和3D扫描中的元素,从而使最终用户的输出看起来最佳。甚至自拍杆之类的普通配件也获得了AI的力量:智云的Smooth XS云台结合了电机和AI软件,可根据被跟踪物体的移动自动改变智能手机视频或相机的位置,这超出了DJI的功能。类似的Osmo Mobile 3,价格却低得多。

另一方面,传统的摄影配件(例如Moment的一系列出色的附加镜头及其支持软件)仍在重新调整过程中,以适应Apple设备的最新变化。现在,金属和玻璃镜片的质感要与iPhone 12 Pro和Max的新分离的相机系统相抗衡,这要求该公司生产如下所示的新机壳和仍在生产中的“插入式”镜架。预计将于12月发布。

有趣的是,苹果公司决定在新款iPhone上使用基于激光雷达的自动对焦系统,该功能旨在通过深度了解来增强其基于像素的感知能力,从而帮助传统相机更快,更准确地对焦,这也可能带来挑战。镜头制造商。用镜头遮挡激光雷达扫描仪可能会阻止自动对焦正常工作,这需要Moment的软件禁用激光雷达并使用其他对焦方式。

明年如何解决其中一些小问题还有待观察,以及下一代Android手机和iPhone有望带来更大的改进。我们可能会在12月初举行的下届高通技术峰会上预览2021年的某些技术,不过我们将不得不拭目以待,看看明年哪些公司真正采用了最新的Android技术。无论结果如何,我很高兴看到未来的芯片和相机传感器将使什么成为可能,并且希望您继续关注明年的所有新闻。