原标题:AI社会学|不,这不是“中国人在不在乎隐私”的问题

这看起来像是发生在上个世纪的事。

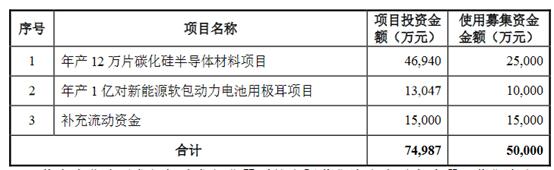

2002年,初出茅庐的统计学硕士安德鲁·波尔(Andrew Pole)在美国排名仅次于沃尔玛的连锁超市Target开始打人生的第一份工。作为底层打工人,彼时他接到的任务是,从Target收集的用户数据里(信用卡号、购买商品,年龄、性别等等),“找出”那些正在怀孕的女顾客。

对压力山大的市场部来说,怀孕的女顾客们就是金矿——心理学家们很早就发现,在消费者漫长的一生里,有少数几个会彻底改变他们购物习惯的时刻,迎接新生命就是其中之一。如果一家超市能在顾客怀孕待产的阶段针对性推送她们感兴趣的商品优惠券,准妈妈们很可能就此被套牢,在婴儿降生无暇他顾的时段里习惯性地从Target反复购物,从此成为该店至死不渝的忠实顾客。

Duhigg, Charles. "How companies learn your secrets." The New York Times 16, no. 2 (2012): 1-16.

问题是,要从茫茫汪洋般的用户数据里找出可能正在怀孕的顾客,并不是一件容易的事。那时,统计学在海量用户行为数据里施展神通的时代才刚刚开始。波尔反复对已知怀孕顾客的购物数据进行分析,搭建了一个所谓的“怀孕预测模型”,以及与此模型相关的25项商品。

波尔发现,在怀孕的不同阶段,女性顾客们购买的商品会呈现出非常相似的规律,例如怀孕初期她们会购买大瓶的无香身体乳,中期会购买一些维生素,孕后期则是大包装的无香香皂和棉球。

根据Target已有的数据,波尔模型预测顾客怀孕的准确率高达87%,如果一名顾客真的怀孕了,模型甚至能预测她们正处在孕期的第几个阶段,并推算出准确的预产期。

在波尔创建“怀孕预测模型”一年后,一个中年男人走进了Target 位于美国明尼苏达州的门店,愤怒地向店员投诉,他还在上高中的女儿收到了各式婴儿用品的优惠券——“她还是个孩子!你们却给她寄婴儿摇篮和衣服的优惠券?你们是想鼓励她怀孕吗?”很快,男人发现,他正在上高中的女儿真的怀孕了。

正如模型搭建者波尔所说:“We’ll be sending you coupons for things you want before you even know you want them” 。依赖真实可靠的用户数据和统计模型,Target远在顾客的购物行为之前,就已经预测到了购物意愿的发生。

这就是AI时代“隐私故事”的开始,如今,它仍在继续。

AI时代行为预测的另一个里程碑,出现在2013年——鼎鼎大名的《美国国家科学院院刊》(PNAS) 刊发了由大卫·斯蒂尔威尔(David Stillwell)和麦克·科辛斯基(Michal Kosinski)团队合作的论文 “Private traits and attributes are predictable from digital records of human behavior”(“人类行为的电子足迹可以预测私人特质”)。

这篇论文依据脸书(Facebook)用户的点赞数据建模,用以预测用户的性格特征,迄今已有2000多次引用。论文使用的数据集为斯蒂尔威尔此前为脸书开发的第三方性格测试小工具myPersonality—— myPersonality使用经典的心理学量表测量用户的人格特质(譬如开放性、稳定性等等),当时就吸引了多达600万的脸书用户。

论文发现,仅仅通过用户的点赞数据,算法模型就可以精确地预测出用户的某些性格和人口学特征。比如,模型对种族和性别的预测准确度可以达到90%以上。当然,模型还推算出一些只有相关性并无因果性的特质,供君茶余饭后一笑。譬如,喜欢圈圈薯条(curly fries)的人可能智商相对较高,喜欢丝芙兰(Sephora)的人可能智商相对较低;点赞游泳、《圣经》、《傲慢与偏见》的人对生活满意程度较高;而点赞《科学》杂志、iPod的人对生活的满意程度较低。

谁也没料到,这篇论文会成为日后臭名昭著的“脸书数据门”的起点。论文发表一年之后,斯蒂尔威尔和科辛斯基的剑桥同事、另一位心理学家亚历山大·科根(Aleksandr Kogan),与英国数据公司“剑桥分析”(Cambridge Analytica)达成协议,由科根依葫芦画瓢式地写了一个心理学小程序,在众包平台上雇佣脸书用户填写,并购买他们的行为和人口学数据。

值得注意的是,科根的小程序不仅收集和购买用户数据,同时还收集用户网络里好友的数据——雪球越滚越大,到“脸书数据门”爆发的时候,“剑桥分析”号称已经掌握5000万脸书用户的行为数据。

这5000万泄露的用户数据到底在2016年美国大选和之后英国脱欧里扮演了怎样的角色,迄今仍是个未解之谜。有人说“剑桥分析”完全可以利用算法推算出社交网络上用户的各项人口学特征、性格以及政治取向,从而针对性地发送政治竞选广告。譬如,对在民主党和共和党间摇摆的白人单身妈妈们狂轰滥炸特朗普的竞选广告。

“剑桥分析”对种种指控予以否认。然而,不可否认的是,“脸书数据门”曝光的2018年是脸书跌入谷底的一年,大佬扎克伯格从此频频出入国会听证会,成为监管部门的重点关注对象,脸书更在2019年被美国联邦贸易委员会(FTC)课以高达50亿美元的罚款。

之后,扎克伯格说,“我们有责任保护人们的隐私……我们要为我们的行业建立一个全新的标准。”

然而,这仅仅是隐私的问题吗?

2017年,脸书开发了另一个人工智能算法,号称可以通过用户发表的帖子和帖子下面朋友的回复,找出那些具有“自杀倾向”的人。这个人工智能算法建立在行为模式识别的基础上,在早先已经被证明“有自杀可能”的帖子的数据集里进行训练。从科技向善的角度上来说,这样的算法当然可以在早期进行自杀干预,或是为用户提供各类预防性求助服务。

但是,就在同一年,英国《卫报》根据一份泄露的内部材料报道说,脸书在某次与广告商金主爸爸的内部恳谈会上声称,它可以通过其平台上收集的数以万计的用户信息,实时监控年轻人的情感状态。换句话说,使用类似的人工智能算法,它可以知道哪些人在此时此刻正在感到“压力大,焦虑,紧张,愚蠢,无用和失败”;也可以知道哪些人正在讨论健身、减肥和塑身,以及哪些人正在对自己的外表和体型感到不满。尽管《卫报》并没有正面讨论脸书收集这些数据和搭建模型的目的,但由于报道采用的内部材料是脸书为广告商们准备的,其算法的目的基本不言自明。

很长一段时间里,我们对科技平台收集数据的警觉和干预,停留在“隐私”的层面。决策者和立法者们会说,用户数据属于隐私,有关平台在采集数据时,应秉承“公开透明”的原则,告知用户数据收集的种类、过程和方式,并取得用户的“同意”。

然而,在AI时代,完全的“公开透明”可能吗?传播学者马修·克雷恩(Matthew Crain)的回答是“否”。在那篇题为“The limits of transparency: Data brokers and commodification”(“透明的局限:数据掮客和商品化”)的著名文章里,克雷恩指出,

对平台来说,用户数据早已经不再是数据,而是商品

。而用户数据商品化的过程,注定了数据会在不同平台和黑市里被打包,经由数据掮客(data broker)的转手,被层层交易至任何平台、组织或个人都无法溯源的层面。也就是说,在用户数据问题上,真正的“公开透明”是不存在的。为此,克雷恩建议从源头上杜绝个人信息的商品化,也就是改变平台通过变卖用户数据及其衍生产品“算法”来盈利的模式。

另一批学者则对用户数据的属性进行追问——用户数据是隐私吗,或者,仅仅是隐私吗?在“隐私”的框架下,用户数据是属于个人的,但事实上,在AI算法的眼里,是没有完全“个人”的数据的——算法可以从你个人的数据里推算出跟你类似的那群人的喜好。比如,网飞(Netflix)会告诉你,因为刚刚看过《哈利波特》的人都继续看了《指环王》,你可能也会喜欢《指环王》。换句话说,你的数据其实并不仅仅属于你个人。

杜克大学的公共政策学者飞利浦·那不勒斯(Philip M. Napoli)认为,在“隐私”框架下将数据私人产权化,其实错误地理解了AI时代数据的价值。他以新近出现的“付费换隐私”的操作为例。

近来有不少初创公司承诺不收集用户个人信息,前提是该用户定期支付一定的费用——通常是5美元/月。也就是说,用户每个月付5美元,就可以换取个人数据不被收集的“隐私权”。这种操作的弊端是显而易见的:

其一,将“隐私”和“个人数据”明码标价,严重损害了弱势群体的利益——如果你付不起每月5美元,是否说明你就不配享有隐私权?

其二,单独个体的数据也许只值5美元/月,100万个用户的数据合起来,通过算法建模,其价值可能难以估量——可以被用来预测城市交通、流感趋势,乃至下一届大选。

平台权力的起点也许是5美元/月的个人数据,然而,定义其权力边界的却是数以万计的群体数据

。

那不勒斯因此认为,

用户数据应该从私有平台里分离,被归类为“公共资源”, 并受到政策法律的强力监管

。

2018年,百度大佬李彦宏曾在某次采访里说:“我想中国人可以更加开放,对隐私问题没有那么敏感。如果他们愿意用隐私交换便捷性,很多情况下他们是愿意的,那我们就可以用数据做一些事情。”

从前我们常常会问“中国人真的不在乎隐私吗”;现在这句话的关键也许在于,“用数据做什么事情?”

大型科技平台有权在用户情感脆弱的时刻推送个性化——譬如减肥/瘦身/整容——的广告吗?它们有权在用户人生的关键时期——譬如怀孕时——发送能改变用户终身购物习惯的优惠券吗?它们有权根据用户不同的人格特征和性格取向推送可能影响选票的政治选举广告吗?

上文说到脸书的“自杀预测”算法,它既可以用来提供对弱势群体的公共帮助,也可以用来推送针对性的广告。但是,如果一家平台的广告收入占到其总收入的90%以上,这样的算法更有可能被用来做什么呢?

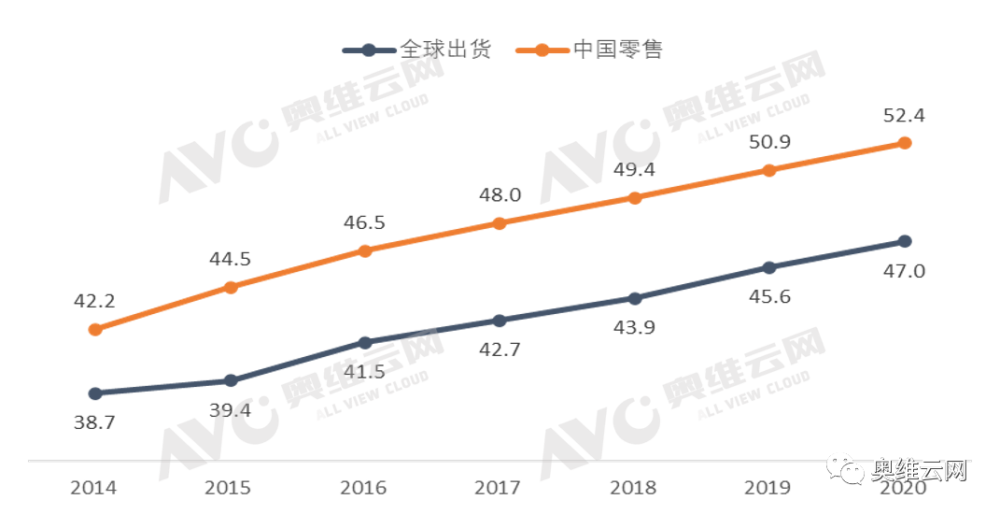

2020年的最新数据显示,即使在全球瘟疫大流行时期,脸书的总收入仍强势逆袭,同比增长22%,达到860亿美元,其中广告收入增长21%,达到842亿美元。这一年,广告收入占到其总收入的98%。

显然,脸书并不是唯一一家以广告为生的科技平台。

参考文献:

[1]Duhigg, Charles. "How companies learn your secrets." The New York Times 16, no. 2 (2012): 1-16.

[2]Kosinski, Michal, David Stillwell, and Thore Graepel. "Private traits and attributes are predictable from digital records of human behavior." Proceedings of the national academy of sciences 110, no. 15 (2013): 5802-5805.

[3]Kelion, Leo. "Facebook artificial intelligence spots suicidal users." BBC News, March 1 (2017).

[4]Levin, Sam. "Facebook told advertisers it can identify teens feeling insecure and worthless." The Guardian 1 (2017).

[5]Crain, Matthew. "The limits of transparency: Data brokers and commodification." new media & society 20, no. 1 (2018): 88-104.

[6]Philip M. Napoli, "Who should own your digital data?" The Hill, 2019.

[7]“李彦宏:中国人多数情况下愿意用隐私交换便捷性”,http://news.sina.com.cn/s/wh/2018-03-26/doc-ifysrivq8493582.shtml

-----

作者沈虹,毕业于美国伊利诺伊大学香槟分校传播学系,现任职于美国卡内基梅隆大学。她用社会学的方法研究新兴科技。